Odgovorna, bezbedna i transparentna primena AI sistema

Master AI Governance with the world’s first AI management system standard – ISO/IEC 42001!

Call us or send an e-mail, request an OFFER tailored to your organization!

Primena AI sistema prema prvom svetskom standardu za upravljanje veštačkom inteligencijom

Organizacije širom sveta ubrzano uvode veštačku inteligenciju u svoje poslovanje, ali sa njom dolaze i novi rizici: etičke dileme, pristrasnost algoritama, neusklađenost sa regulativom, gubitak kontrole nad modelima i nedovoljna transparentnost.

ISO/IEC 42001 uvodi prvi formalni okvir za odgovorno upravljanje AI sistemima kroz uspostavljanje AIMS (AI Management System).

Implementacija AIMS a postaje ključ za:

- kontrolu AI procesa,

- upravljanje rizicima,

- usklađivanje sa propisima,

- izgradnju poverenja korisnika i partnera.

Zašto ISO/IEC 42001?

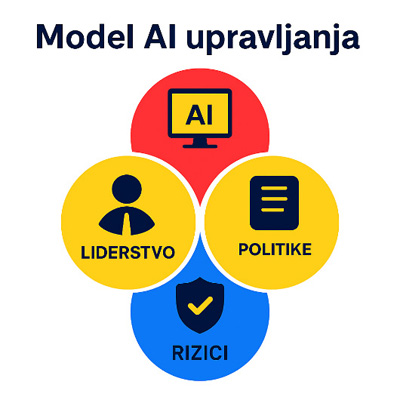

ISO/IEC 42001 omogućava organizacijama da:

- uvedu jasan model upravljanja AI sistemima i odgovornostima

- obezbede mehanizme nadzora, transparentnosti i dokumentacije

- upravljaju rizicima kao što su etičke posledice, pristrasnost, zloupotrebe i bezbednosni incidenti

- isprate zahteve novih AI regulativa i očekivanja regulatora.

Ko treba da primeni ISO/IEC 42001?

Standard je namenjen organizacijama koje:

- razvijaju AI proizvode ili modele

- koriste AI u ključnim procesima (npr. finansije, zdravstvo, bezbednost, proizvodnja)

- upravljaju velikim količinama podataka

- žele da dokažu odgovornu i kontrolisanu upotrebu AI sistema.

Šta obuhvata ISO/IEC 42001?

Struktura standarda prati High-Level Structure (HLS), kao i ISO/IEC 27001, ISO 9001 i druge MSS standarde, uz posebne AI zahteve.

Ključne oblasti:

1. Kontekst organizacije (Clause 4)

- razumevanje AI okruženja i rizika

- utvrđivanje zahteva zainteresovanih strana

- definisanje opsega AIMS sistema

2. Liderstvo i AI politika (Clause 5)

- odgovornost menadžmenta

- AI politika i principi odgovorne upotrebe

- jasna podela uloga

3. Planiranje (Clause 6)

- procena AI rizika (etika, bias, sigurnost, uticaj)

- definisanje AI ciljeva

- planiranje tretmana AI rizika

4. Podrška (Clause 7)

- resursi i kompetencije

- obučavanje zaposlenih

- komunikacija i dokumentacija

5. Operacije (Clause 8)

- operativna kontrola AI sistema

- procena uticaja AI modela

- validacija podataka i modela

6. Evaluacija performansi (Clause 9)

- merenje, nadzor i analiza performansi AI sistema

- interni auditi

- menadžment pregled

7. Unapređenje (Clause 10)

- upravljanje neusaglašenostima

- korektivne mere

- kontinuirano unapređenje

Aneks A – Operativne i sistemske AI kontrole (ISO/IEC 42001)

Aneks A standarda ISO/IEC 42001 sadrži set specifičnih kontrola namenjenih organizacijama koje razvijaju, koriste ili upravljaju AI sistemima. Za razliku od klasičnih menadžment sistema, ove kontrole se fokusiraju na rizike, transparentnost, upravljanje podacima, validaciju modela, etičke principe i specifičnosti AI životnog ciklusa.

Aneks A je osmišljen kao proširenje tradicionalnog HLS modela, uvodeći kontrole koje se odnose na operativno upravljanje AI sistemima, uključujući procene rizika, AI impact assessment, nadzor modela i upravljanje datasetovima.

Šta pokriva Aneks A?

Aneks A obuhvata AI‑specifične kontrole za:

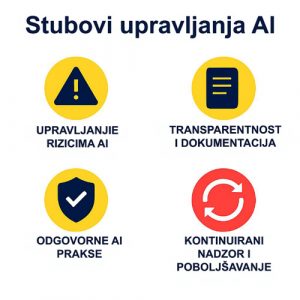

1. Upravljanje AI rizicima

Organizacije moraju identifikovati i upravljati rizicima kao što su:

- algoritamska pristrasnost (bias)

- neobjašnjivost modela

- greške u podacima

- štetan uticaj odluka AI sistema.

Ove kontrole su deo obaveze sprovođenja AI risk assessment i AI risk treatment (deo Clause 6 i Aneks A).

2. Transparentnost i dokumentaciju AI sistema

Standard zahteva:

- evidenciju datasetova

- beleženje verzija modela

- dokumentovanje trening i validacionih procedura

- transparentno objašnjavanje funkcija i ograničenja modela.

Cilj je obezbediti proverljivost i auditabilnost AI sistema.

3. Etiku i odgovorne AI prakse

Kontrole iz Aneksa A uključuju obavezu primene principa:

- pravičnosti

- ljudske kontrole

- zaštite korisnika

- odgovornosti za AI odluke.

Organizacije moraju dokazati da AI sistemi ne utiču štetno na korisnike ili društvo.

4. Validaciju, testiranje i monitoring AI modela

Aneks A uvodi obavezu:

- periodične validacije modela

- evaluacije performansi

- postavljanja metrika za nadzor

- definisanja tehničkih kriterijuma za ponovno treniranje modela.

Ove kontrole osiguravaju da modeli ostanu tačni, bezbedni i stabilni tokom vremena.

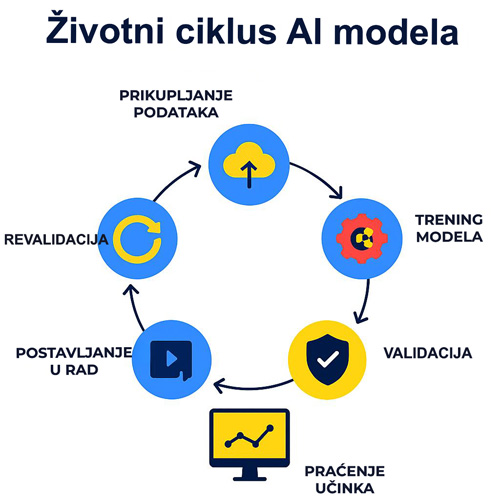

5. Upravljanje životnim ciklusom AI sistema

Kontrole pokrivaju ceo AI životni ciklus:

- dizajn i razvoj

- trening modela

- testiranje i validacija

- implementacija

- praćenje učinka

- revalidacija i povratna informacija

Upravo je ovaj ciklus ono što razlikuje ISO/IEC 42001 od klasičnih MSS standarda.

6. Upravljanje podacima i datasetovima

Posebne kontrole obuhvataju:

- kvalitet podataka

- tokove podataka

- zaštitu podataka

- korekciju datasetova

- kontrolu pristupa

Bez kvalitetnih podataka nema ni pouzdane AI.

7. Bezbednost i privatnost u AI sistemima

Kontrole su usmerene na:

- sprečavanje manipulacije modelima

- zaštitu trening podataka

- sprečavanje model inversion i membership attack‑ova

8. Upravljanje dobavljačima i eksternim modelima

Organizacije moraju:

- proceniti rizike AI komponenti koje isporučuju treća lica

- proveravati usklađenost eksternih AI modela

- upravljati ugovornim obavezama i garancijama

Zaključak: Zašto je Aneks A ključ za sertifikaciju?

Aneks A predstavlja srce ISO/IEC 42001 standarda.

On obezbeđuje da organizacija ne samo da upravlja AI sistemima, već da ih nadzire, kontroliše, dokumentuje i unapređuje u skladu sa etičkim i regulatornim zahtevima.

Sprovedene kontrole iz Aneksa A dokazuju:

- sigurnost i pouzdanost AI sistema

- sposobnost upravljanja rizicima

- doslednu primenu principa odgovorne AI

- transparentnost procesa

- tehničku usklađenost AI modela sa pravilima i zakonom

Organizacije koje adekvatno primene Aneks A lakše ostvaruju sertifikaciju i stiču poverenje klijenata, partnera i regulatora.